はじめに

関西大学の清野陽平です。2024年9月に北海道で開催されたEntertainment Computing2024(EC2024)で行った研究発表について報告いたします。発表タイトルは「はぁ」です。

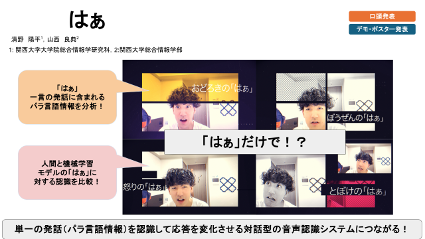

研究概要

この研究では、「はぁ」という一言の発話に含まれるパラ言語情報(非言語情報)の重要性に着目し、その認識と解析を行いました。「はぁ」という言語的な意味を持たない単一の発話から、発話者の意図や感情を読み取ることが可能であるという仮説のもと、データ収集と分析を行いました。

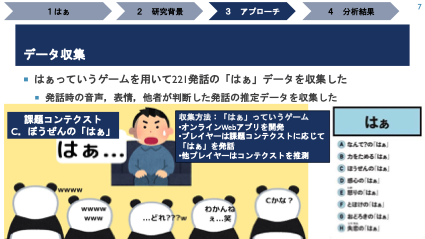

具体的には、「はぁっていうゲーム」を用いて221の「はぁ」発話データを収集しました。このゲームでは、プレイヤーは与えられた8種類のコンテクスト(例:怒り、驚き、疑問など)に応じて「はぁ」を発話し、他のプレイヤーがそのコンテクストを推測します。収集したデータには、音声情報だけでなく、発話時の表情データや他プレイヤーによる推測結果も含まれています。

収集したデータからメル周波数ケプストラム係数(MFCC)を特徴量として抽出し、機械学習モデル(LightGBM)を用いてコンテクスト推定を行いました。また、データの不均衡を解消するためにSMOTE(Synthetic Minority Over-sampling Technique)を適用しました。

実験結果と考察

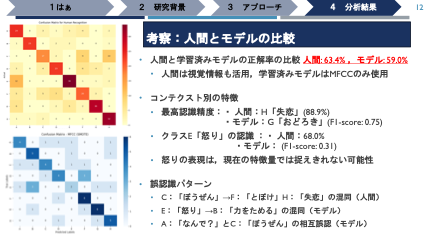

人間による「はぁ」発話のコンテクスト推定の正解率は約63.4%でした。これは8種類のコンテクストにおけるチャンスレベル(12.5%)を大きく上回っており、「はぁ」という単純な発話が多様な感情や意図を一定の精度で伝達可能であることが示されました。

一方、機械学習モデルによる推定の正解率は59.0%でした。人間の推定結果と比較すると若干低いものの、音声特徴量のみを用いて人間に近い精度を達成できたことは注目に値します。コンテクスト別の分析では、人間は「失恋」のコンテクストを最も正確に認識できた一方、モデルは「おどろき」のコンテクストで最高の認識精度を示しました。「怒り」のコンテクストは、人間にとっては比較的認識しやすかったものの、モデルにとっては最も難しいコンテクストでした。これは、怒りの表現が個人差や状況によって多様であり、現在の特徴量では捉えきれない複雑さを持っている可能性を示唆しています。

おわりに

本研究を通じて、「はぁ」という一言であってもパラ言語情報を通じて多様なコンテクストが伝達可能であることが確認されました。同時に、特定のコンテクスト間での区別の難しさや、個人差の影響など、パラ言語情報認識の課題も明らかになりました。今後の課題としては、特徴量の拡張(例えば、時系列の特徴を含んだ音響特徴)やデータの拡充、さらには表情などの視覚情報を統合したマルチモーダルモデルの構築が挙げられます。これらの改善により、より高精度なパラ言語情報の認識が可能になると考えられます。

感想

この研究発表を通じて、パラ言語情報の重要性と機械学習による認識の可能性について、多くの参加者と議論を交わすことができました。今回の経験を今後の研究活動に活かし、さらなる発展を目指して取り組んでいきたいと思います。