第69回エンタテインメントコンピューティング研究発表会,UI / UX1 セッションでM1の清野さんが発表

WHAT WE DO on Octber 活動報告

2023年10月26日(木)、27日(金)に北海道室蘭市で開催された,情報処理学会 第69回エンタテインメントコンピューティング研究発表会で、M1の清野さんが発表しました。

初めに

山西研究室M1の清野です.2023年10月26日-10月27日に室蘭ガス文化センターを会場に開催された「第69回 エンタテインメントコンピューティング(HCI/EC合同)研究発表会)」にて研究発表について報告いたします.

今回は「はぁ」データセットの構築と音声特徴の基礎分析というタイトルで発表しました.

研究概要

日常会話における発話は,コンテクストや感情などによって異なります.

言葉自体に意味を含まない「はぁ」という一言を発話する場合でも,発話者自身が伝えたいコンテクストによって発話は異なります.その差異によって聞き手も発話者が意図したコンテクストをおおよそ理解する事ができると考えられます.

私の研究では,多様な意味を持つ同一発話からの意図の推定を目標とし,コンテクストごとの発話特徴量の究明を目指すために「はぁ」という発話に着目しました.

さらに発話分析の端緒として,「はあ」データセットの構築し,収集したデータに含まれる音声に対する基礎分析を行いました.

データセット構築のために遊びながらデータ収集が可能になるフレームワークを設計し,楽しみながらさらにデータ収集ができることを活かし「はぁ」の発話データを収集しました.

収集した「はぁ」データの各コンテクストの発話に対して,音声全体から抽出される音響特徴量や音量の変化を可視化し分析を行いました.

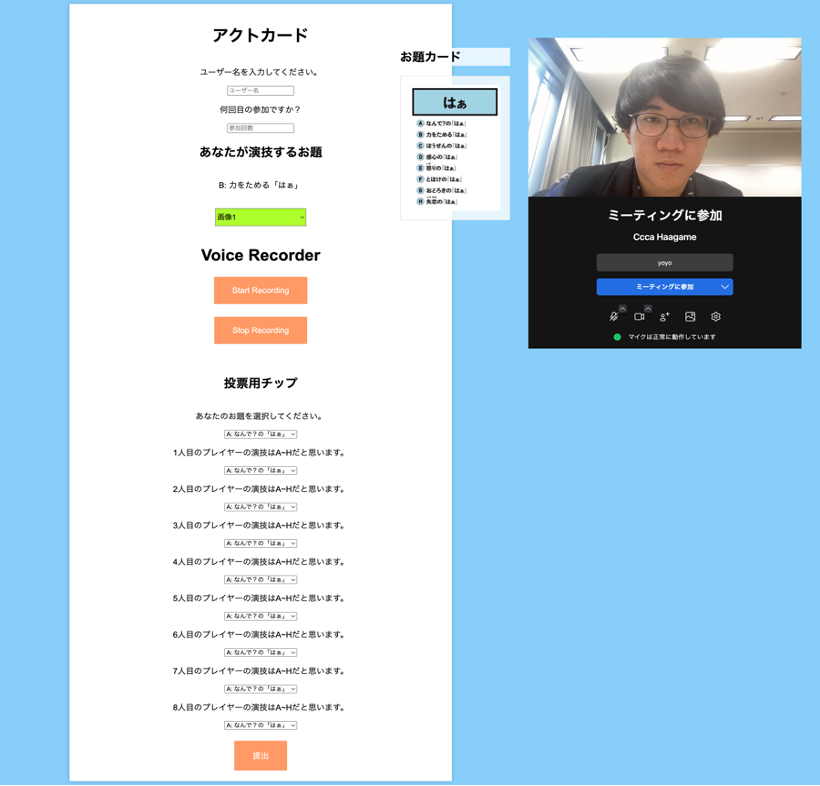

上図は遊びながら可能なデータ収集のために作成したWebアプリの画面です.このWebアプリでは複数人が同時にアクセスをし,ビデオ通話によってコミュニケーションをとりながらオンラインで「はぁ」っていうゲームをプレイするようになっています.

このアプリを用いることで,各課題コンテキストに基づいた「はぁ」発話を収集することが可能になります.収集可能なデータとして,課題コンテキストを発話している際の表情のデータ,発話の音声データ,さらに他者が発話をどのように推定したかという3種のデータを収集することが出来ます.

学会発表までにこのWebアプリを用いて収集することができた53発話を試しに分析を行ったところ以下のような結果になりました.

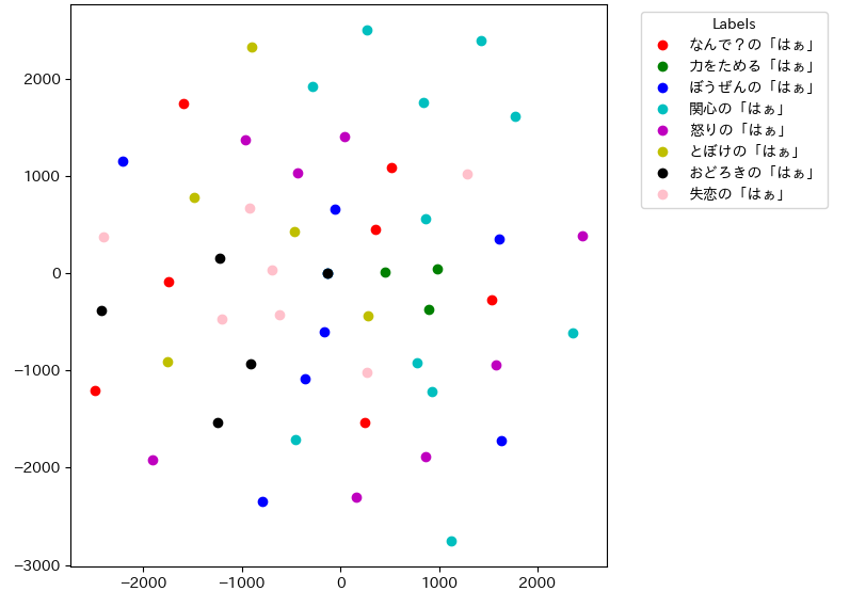

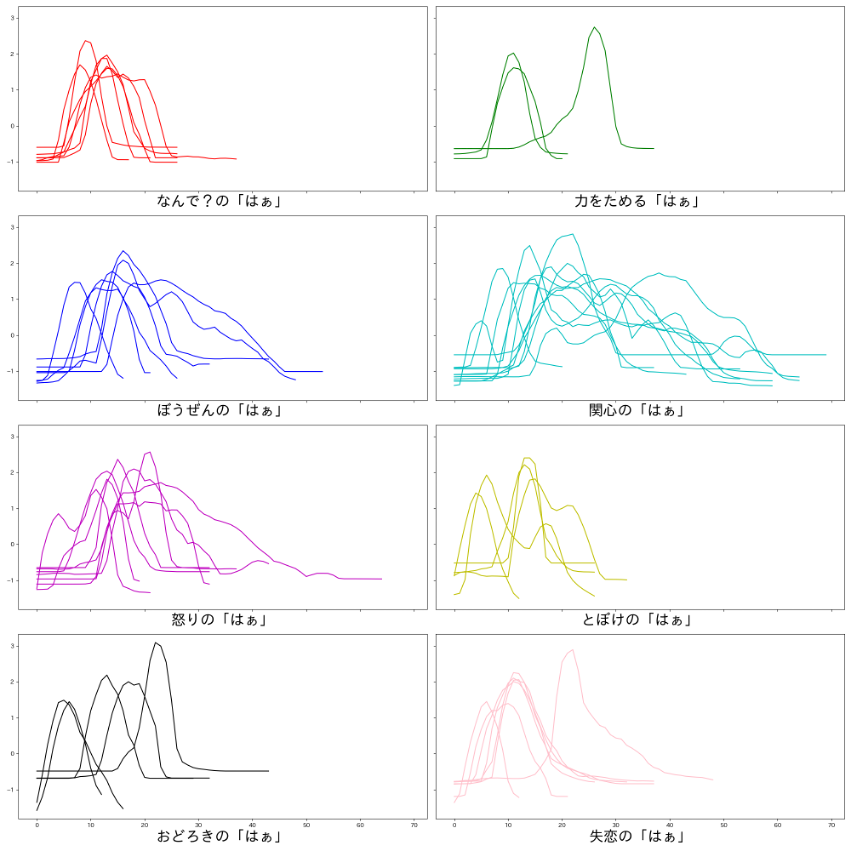

この図は発話から学習済みモデルを用いて音響特徴ベクトルをt-SNE法を用いて可視化した結果と音量の変化の時系列データを取得し可視化した結果です.

話者の元々の特性などを考慮し,取得の際には話者ごとに標準化を行っています.

可視化結果から,以下のようなこと確認できました.

t-SNE法を用いた音響特徴ベクトルの可視化では“関心”や“失恋”といった課題コンテキストが他の課題コンテキストと比較すると近くに配置されていることが確認できます.

音量の変化の可視化結果からは“関心”や“呆然”の音声データでは他の課題コンテキストと比べると発話の時間が長いことが確認できます.

これらのことから,特定の課題コンテキストでは話者によらない普遍的な特徴というものが存在することが示唆されたと考えられます.

感想

自分の発表や他者の発表含め,今回の「第69回 エンタテインメントコンピューティング(HCI/EC合同)研究発表会)」はとても有意義なものとなりました.

まず自分の発表では反省点も多くありますが,成長を実感できたこともありました.

そのほかにも,自分の発表を聞いてくださった上で,自分の研究雨内容に対して自分では考え付かなかった意見を得ることが出来ました.

しかし,反省点も多くあるので,今回感じた反省点を克服し次の発表に活かしたいと考えています.

他者の研究発表では興味をひかれるような発表や,知らない技術を駆使した研究など新たな知識を獲得することができました.

プレゼンの仕方も参考になる方が多く,多くのお手本を見て学ぶことが出来ました.

英語もスライドの発表を見た時,理解が難しく,もう少し英語を学ぶ必要があると感じました.

text:エンピツ舎